Một công trình nghiên cứu xuất phát từ luận văn đại học của thầy và trò Khoa Khoa học và Kỹ thuật Máy tính, Trường Đại học Bách khoa (Đại học Quốc gia TPHCM) đã trải qua hơn 2 năm kiên trì hoàn thiện, qua nhiều vòng phản biện và không ít lần bị từ chối.

Kết quả, nghiên cứu đã chính thức được chấp nhận công bố trên tạp chí quốc tế uy tín trong lĩnh vực trí tuệ nhân tạo trong giáo dục - một thành quả vượt ngoài kỳ vọng của chính nhóm tác giả.

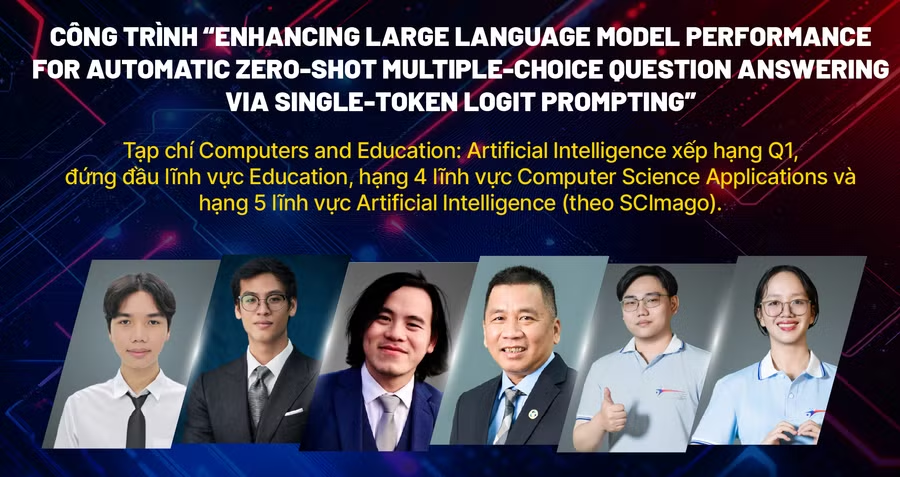

Công trình mang tên “Enhancing Large Language Model Performance for Automatic Zero-Shot Multiple-Choice Question Answering via Single-Token Logit Prompting” (Nâng cao khả năng trả lời câu hỏi trắc nghiệm tự động của mô hình ngôn ngữ lớn bằng kỹ thuật nhắc lệnh Single-Token Logit) được đăng trên tạp chí Computers and Education: Artificial Intelligence - tạp chí mở của Elsevier, hiện xếp hạng Q1, đứng đầu lĩnh vực Education, hạng 4 lĩnh vực Computer Science Applications và hạng 5 lĩnh vực Artificial Intelligence theo SCImago.

Nhóm tác giả gồm Đặng Phú Quốc (cựu sinh viên Trường ĐH Bách khoa, đồng tác giả chính), Trần Trương Tuấn Phát (giảng viên Trường Đại học Bách khoa, đồng tác giả chính), TS. Vũ Đức Lý (giảng viên Trường Đại học Quốc tế Miền Đông), cùng hai sinh viên năm ba của Trường Đại học Bách khoa, gồm Nguyễn Song Thiên Long và Võ Thị Như Quỳnh.

Công trình được thực hiện dưới sự hướng dẫn của PGS. TS. Quản Thành Thơ - Trưởng khoa Khoa học và Kỹ thuật Máy tính, Trường Đại học Bách khoa.

Khởi đầu từ luận văn tốt nghiệp của sinh viên Đặng Phú Quốc, nghiên cứu ban đầu chỉ đặt mục tiêu giải quyết một bài toán cụ thể liên quan đến mô hình ngôn ngữ lớn (LLM), không hướng tới công bố ở các tạp chí thứ hạng cao.

Việc lựa chọn nơi nộp bài được thực hiện theo gợi ý của nhà xuất bản Elsevier. Tính từ khi bắt đầu đề tài đến khi được chấp nhận đăng tải, nhóm đã trải qua 2 năm 4 tháng với nhiều lần chỉnh sửa, phản biện và nộp lại bản thảo.

Nghiên cứu tập trung giải quyết một hạn chế quan trọng của các mô hình ngôn ngữ lớn mã nguồn mở như LLaMA, DeepSeek hay Mistral khi xử lý câu hỏi trắc nghiệm (MCQ) trong bối cảnh không có hướng dẫn cụ thể (zero-shot).

Thực tế cho thấy, chỉ cần thay đổi thứ tự các phương án A, B, C, D - dù nội dung câu hỏi giữ nguyên - mô hình có thể đưa ra kết quả khác nhau.

Nguyên nhân đến từ cơ chế hoạt động của LLM: các mô hình này được tối ưu hóa để dự đoán token tiếp theo, nên dễ bị ảnh hưởng bởi vị trí hoặc ký hiệu đáp án thay vì thực sự hiểu nội dung.

Hiện tượng này được gọi là giới hạn Multiple-Choice Symbol Binding (MCSB), làm suy giảm đáng kể độ tin cậy khi ứng dụng trong giáo dục, đặc biệt ở các tác vụ như chấm bài hay xây dựng ngân hàng câu hỏi.

Để khắc phục, nhóm đề xuất kỹ thuật Single-Token Logit (STL) - một chiến lược prompting thay đổi cách mô hình tiếp cận bài toán. Thay vì đưa ra toàn bộ đáp án cùng lúc và yêu cầu lựa chọn, STL tách từng phương án, ghép với câu hỏi và yêu cầu mô hình trả lời theo dạng có/không: đáp án này có đúng không. Kết quả cuối cùng được xác định dựa trên xác suất của token “yes” trong từng lần đánh giá.

Cách tiếp cận này giúp mô hình đánh giá từng lựa chọn một cách độc lập, giảm ảnh hưởng của vị trí và nhãn đáp án, qua đó trực tiếp khắc phục hạn chế MCSB.

Bên cạnh đó, nhóm tích hợp phương pháp Retrieval-Augmented Generation (RAG), cho phép mô hình truy xuất thêm tri thức từ nguồn dữ liệu bên ngoài. Nghiên cứu được đánh giá toàn diện trên ba bộ dữ liệu khoa học chuẩn gồm ARC, OpenBookQA và SciQ trong nhiều điều kiện ngữ cảnh khác nhau.

Kết quả cho thấy STL đạt hiệu năng tương đương hoặc vượt các phương pháp phổ biến, bao gồm cả Chain-of-Thought (CoT), với mức cải thiện lên tới 11 điểm phần trăm ở một số cấu hình, đồng thời giảm đáng kể chi phí tính toán.

Về ứng dụng thực tiễn, kỹ thuật STL có thể hỗ trợ giáo viên rà soát chất lượng đề thi, tự động gợi ý đáp án cho câu hỏi chưa có lời giải, hỗ trợ chấm bài và phát triển các hệ thống học tập thông minh có khả năng giải thích kết quả đánh giá.

Ở góc nhìn rộng hơn, nghiên cứu cũng gợi mở một hướng tiếp cận đáng chú ý trong phát triển AI: việc nâng cao độ tin cậy của mô hình không nhất thiết phụ thuộc vào việc mở rộng quy mô hay tăng độ phức tạp kiến trúc - đôi khi, một điều chỉnh nhỏ trong cách thiết kế prompt cũng có thể tạo ra khác biệt lớn trong triển khai thực tế.